Các chatbot AI dựa trên đám mây như ChatGPT và Gemini mang lại sự tiện lợi đáng kể, nhưng chúng cũng đi kèm với những đánh đổi nhất định. Việc chạy một mô hình ngôn ngữ lớn (LLM) cục bộ – công nghệ nền tảng đằng sau các chatbot AI – giúp bạn kiểm soát hoàn toàn, mang lại khả năng truy cập ngoại tuyến và bảo mật dữ liệu mạnh mẽ hơn. Mặc dù nghe có vẻ phức tạp về mặt kỹ thuật, nhưng với các ứng dụng phù hợp, bất kỳ ai cũng có thể dễ dàng bắt đầu khám phá thế giới AI cục bộ. Bài viết này sẽ giới thiệu 5 ứng dụng hàng đầu giúp bạn thực hiện điều đó một cách đơn giản nhất.

5. Ollama

Ollama là một ứng dụng thân thiện với người dùng, được thiết kế để giúp các cá nhân vận hành các mô hình LLM cục bộ một cách hiệu quả mà không yêu cầu kiến thức chuyên môn kỹ thuật sâu rộng. Ứng dụng này cho phép bạn chạy các mô hình AI mạnh mẽ trên phần cứng phổ thông như máy tính xách tay. Ollama nổi bật nhờ sự đơn giản và dễ tiếp cận, không đòi hỏi thiết lập phức tạp nào.

Ứng dụng hỗ trợ nhiều loại mô hình khác nhau và có sẵn phiên bản dành cho máy tính để bàn trên macOS, Windows và Linux, đảm bảo bạn có thể sử dụng bất kể nền tảng nào. Quy trình cài đặt rất đơn giản, và chỉ trong chốc lát, bạn sẽ sẵn sàng chạy các mô hình LLM trên thiết bị của mình.

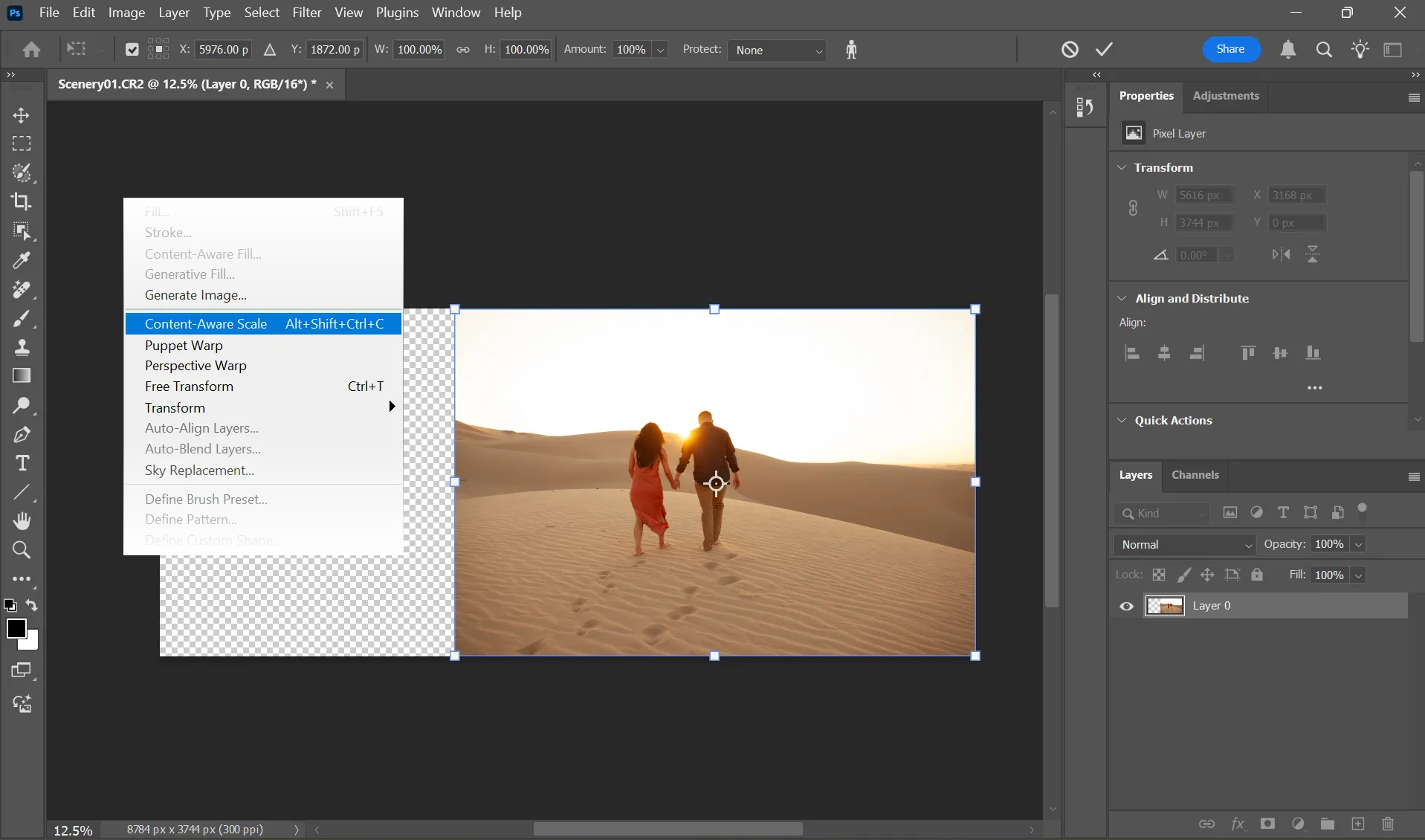

Để khởi chạy một mô hình, bạn sử dụng lệnh ollama run [tên mô hình]. Bạn có thể chỉ định một trong các LLM được hỗ trợ ở cuối lệnh. Ví dụ, để chạy mô hình Phi 4 của Microsoft, bạn chỉ cần nhập lệnh sau:

ollama run phi4Để chạy Llama 4, hãy nhập:

ollama run llama4Mô hình được chỉ định sẽ tự động tải xuống và bắt đầu chạy. Sau đó, bạn có thể trò chuyện trực tiếp với nó từ dòng lệnh. Ví dụ, bạn có thể chạy DeepSeek cục bộ trên máy tính xách tay bằng Ollama.

Mô hình DeepSeek-R1 đang chạy trong giao diện dòng lệnh của ứng dụng Ollama.

Mô hình DeepSeek-R1 đang chạy trong giao diện dòng lệnh của ứng dụng Ollama.

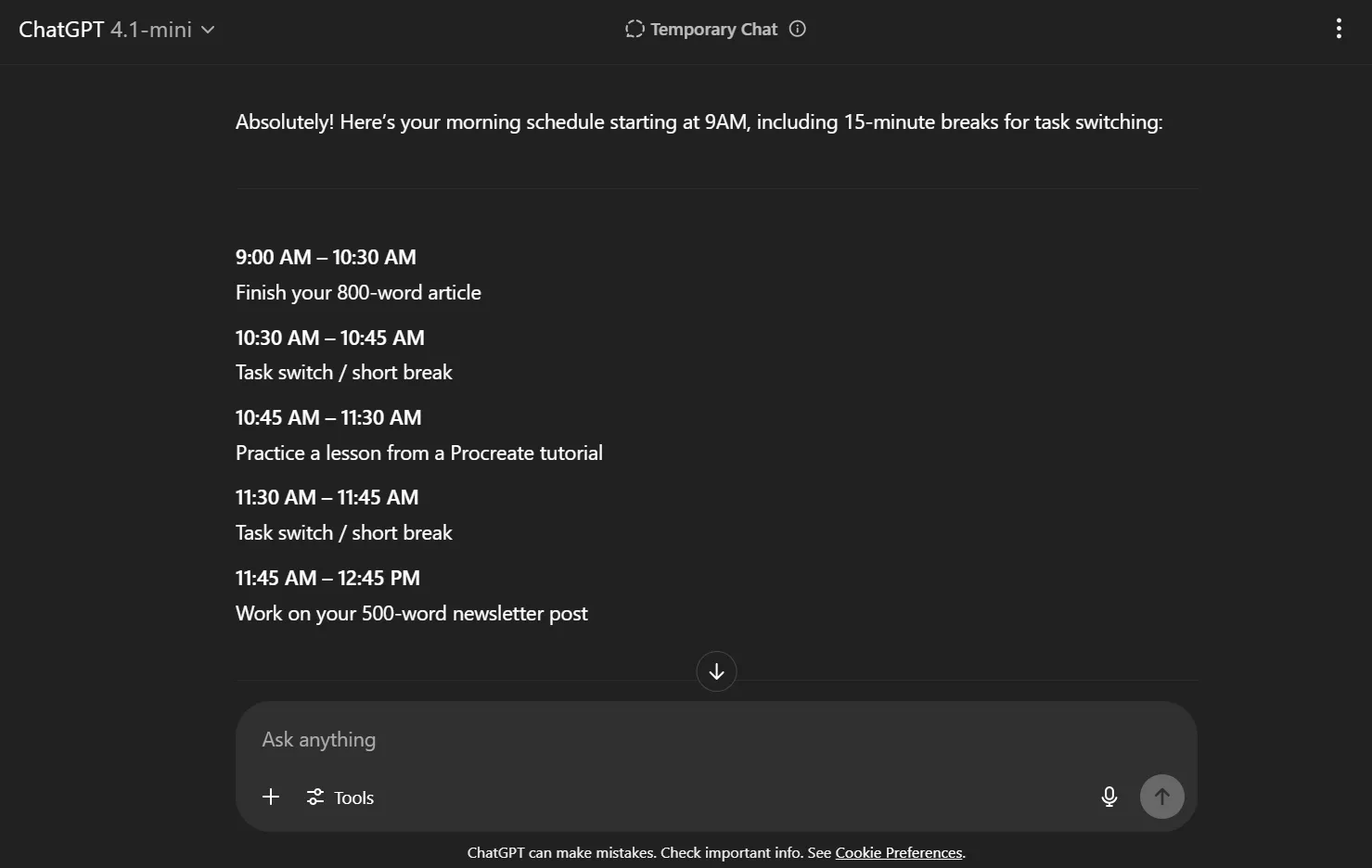

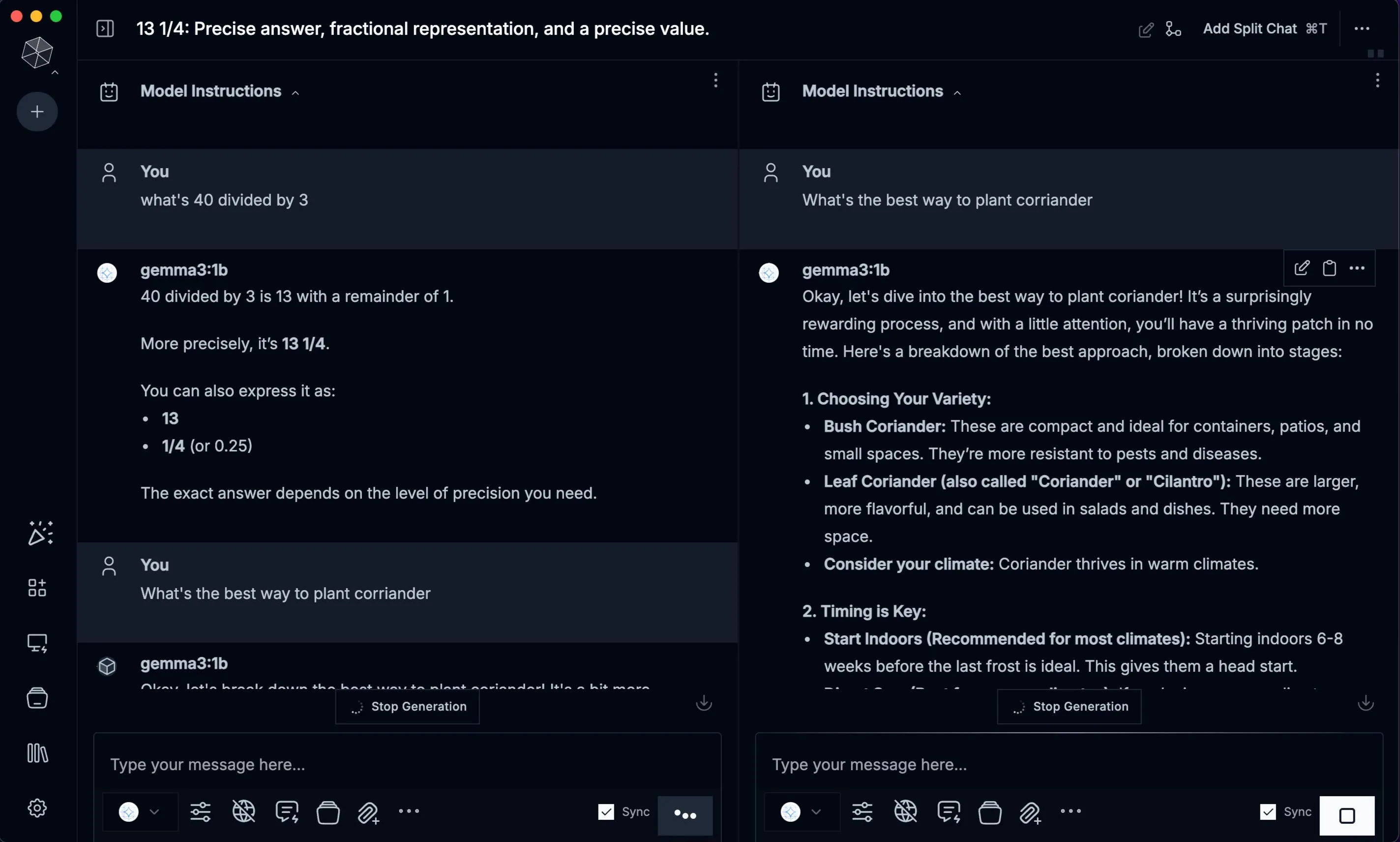

4. Msty

Tương tự như Ollama, Msty là một ứng dụng thân thiện với người dùng giúp đơn giản hóa việc chạy các mô hình LLM cục bộ. Có sẵn cho Windows, macOS và Linux, Msty loại bỏ những phức tạp thường liên quan đến việc vận hành LLM cục bộ, chẳng hạn như cấu hình Docker hoặc giao diện dòng lệnh.

Ứng dụng cung cấp nhiều mô hình đa dạng mà bạn có thể chạy trên thiết bị của mình, với các tùy chọn phổ biến như Llama, DeepSeek, Mistral và Gemma. Bạn cũng có thể tìm kiếm mô hình trực tiếp trên Hugging Face, một trang web tuyệt vời để khám phá các chatbot AI mới. Sau khi cài đặt, ứng dụng sẽ tự động tải xuống một mô hình mặc định về thiết bị của bạn.

Sau đó, bạn có thể tải xuống bất kỳ mô hình nào bạn muốn từ thư viện. Nếu bạn muốn tránh giao diện dòng lệnh bằng mọi giá, Msty là ứng dụng hoàn hảo dành cho bạn. Giao diện dễ sử dụng của nó mang lại trải nghiệm cao cấp.

Ứng dụng cũng bao gồm một thư viện lời nhắc (prompts) với một số tùy chọn được tạo sẵn mà bạn có thể sử dụng để hướng dẫn các mô hình LLM và tinh chỉnh phản hồi. Ngoài ra, nó còn có tính năng không gian làm việc để giữ các cuộc trò chuyện và tác vụ của bạn được sắp xếp gọn gàng.

Giao diện ứng dụng Msty hiển thị khả năng chạy mô hình ngôn ngữ lớn (LLM) cục bộ trên macOS.

Giao diện ứng dụng Msty hiển thị khả năng chạy mô hình ngôn ngữ lớn (LLM) cục bộ trên macOS.

3. AnythingLLM

AnythingLLM là một ứng dụng máy tính để bàn tiện lợi được thiết kế cho những người dùng muốn chạy LLM cục bộ mà không cần thiết lập phức tạp. Từ cài đặt đến lời nhắc đầu tiên của bạn, quá trình này diễn ra mượt mà và trực quan. Nó mang lại cảm giác như bạn đang sử dụng một mô hình LLM dựa trên đám mây.

Trong quá trình thiết lập, bạn có thể tải xuống các mô hình bạn chọn. Một số LLM ngoại tuyến tốt nhất, bao gồm DeepSeek R1, Llama 4, Microsoft Phi 4, Phi 4 Mini và Mistral, đều có sẵn để tải xuống.

Giống như hầu hết các ứng dụng trong danh sách này, AnythingLLM hoàn toàn là mã nguồn mở. Nó bao gồm nhà cung cấp LLM riêng và cũng hỗ trợ nhiều nguồn bên thứ ba, bao gồm Ollama, LM Studio và Local AI, cho phép bạn tải xuống và chạy các mô hình từ các nguồn này. Nhờ đó, nó cho phép bạn chạy hàng trăm, nếu không phải hàng nghìn, mô hình LLM có sẵn trên web.

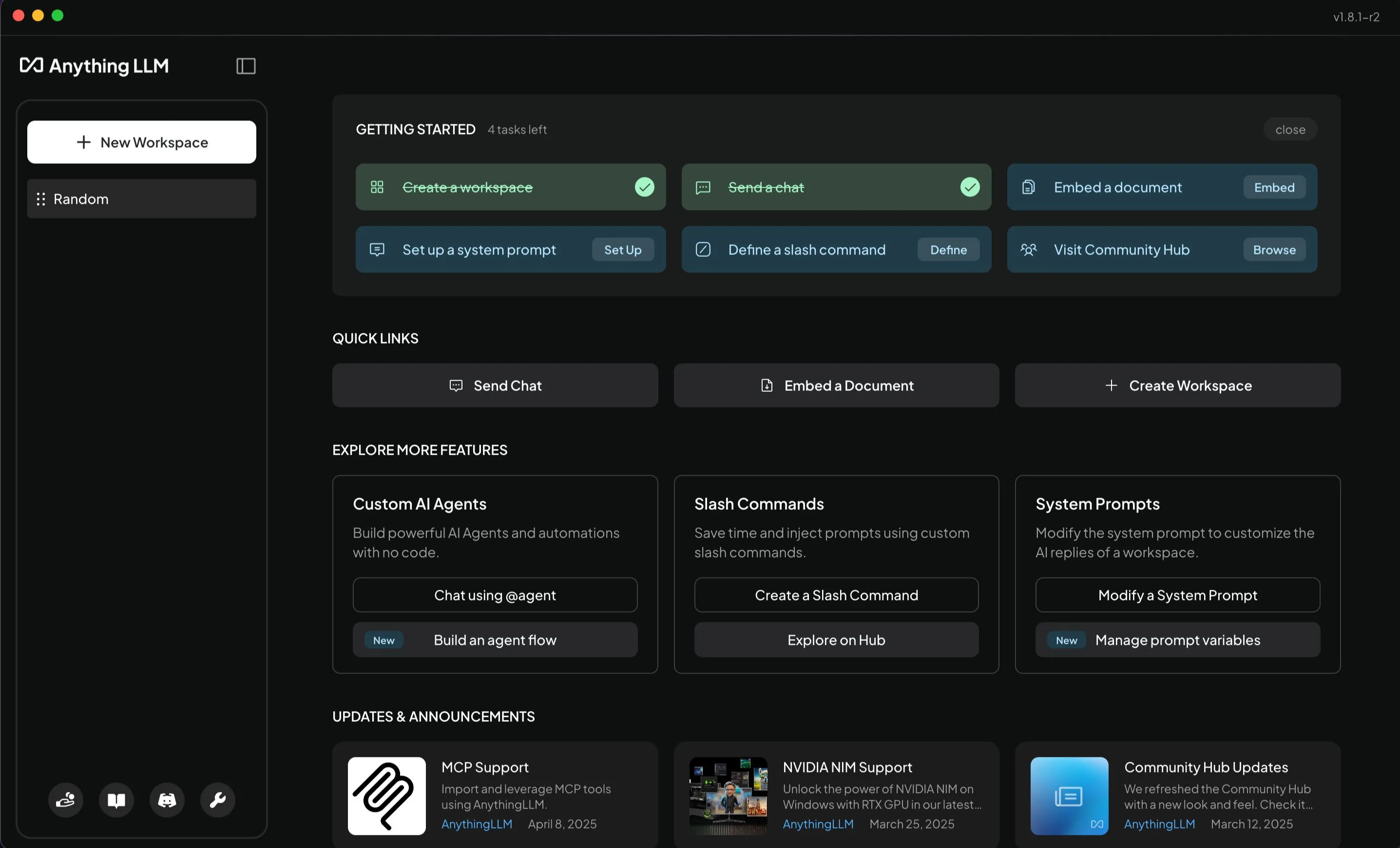

Màn hình chính của ứng dụng AnythingLLM trên macOS, thể hiện giao diện người dùng trực quan.

Màn hình chính của ứng dụng AnythingLLM trên macOS, thể hiện giao diện người dùng trực quan.

2. Jan.ai

Jan tự quảng bá mình là một lựa chọn thay thế ChatGPT mã nguồn mở chạy ngoại tuyến. Ứng dụng này cung cấp một ứng dụng máy tính để bàn gọn gàng để chạy các mô hình LLM khác nhau cục bộ trên thiết bị của bạn. Bắt đầu với Jan rất dễ dàng. Sau khi cài đặt ứng dụng (có sẵn trên Windows, macOS và Linux), bạn sẽ được cung cấp một số mô hình LLM để tải xuống.

Chỉ một vài mô hình được hiển thị mặc định, nhưng bạn có thể tìm kiếm hoặc nhập URL của Hugging Face nếu bạn không thấy mô hình mình đang tìm kiếm. Bạn cũng có thể nhập một tệp mô hình (ở định dạng GGUF) nếu bạn đã có sẵn cục bộ. Thực sự không thể dễ dàng hơn thế. Ứng dụng này bao gồm các LLM dựa trên đám mây trong danh sách của nó, vì vậy hãy đảm bảo áp dụng bộ lọc thích hợp để loại trừ chúng.

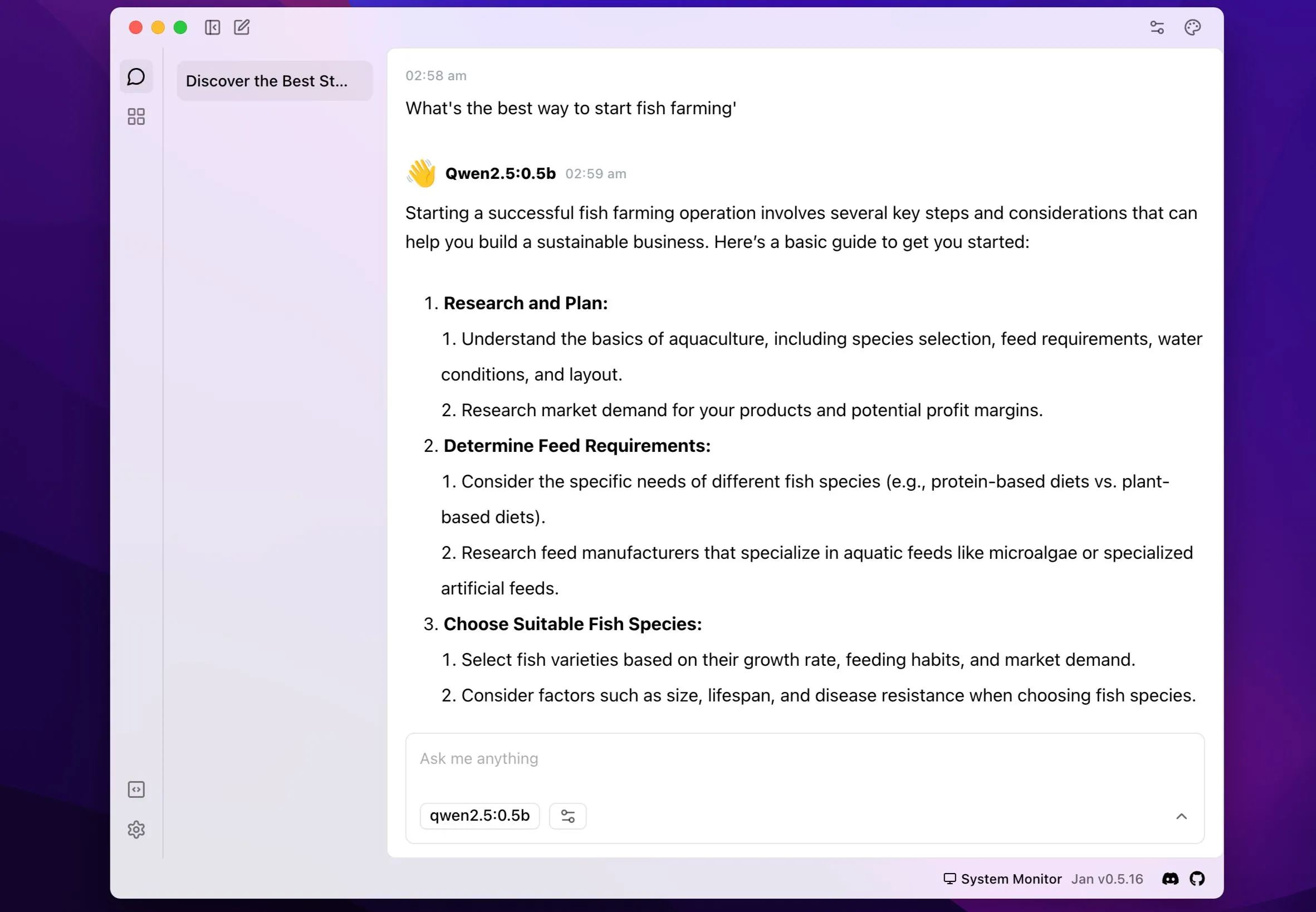

Giao diện người dùng của Jan.ai hiển thị cuộc trò chuyện với mô hình Qwen LLM được chạy cục bộ.

Giao diện người dùng của Jan.ai hiển thị cuộc trò chuyện với mô hình Qwen LLM được chạy cục bộ.

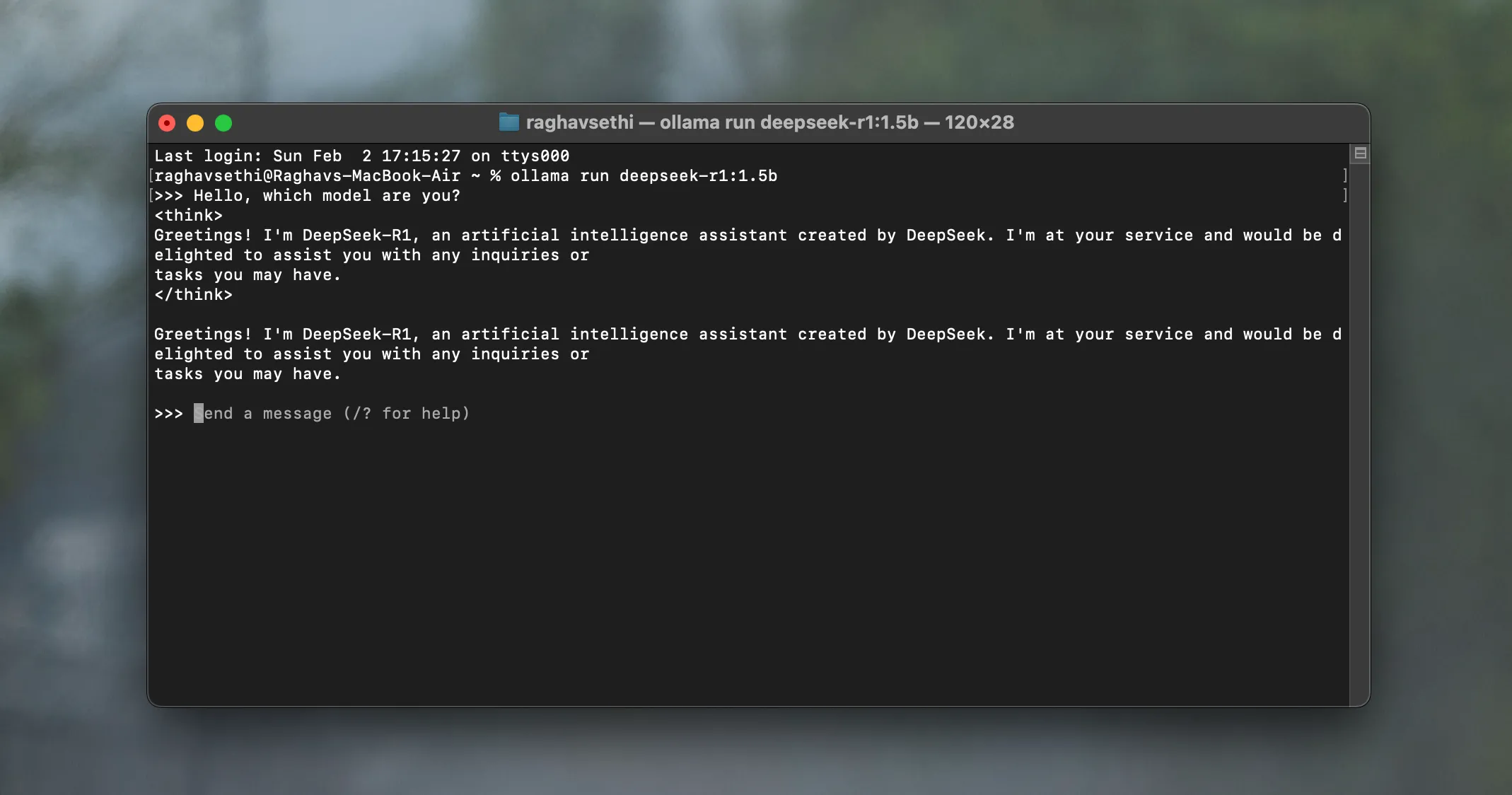

1. LM Studio

LM Studio là một ứng dụng khác cung cấp một trong những cách tiếp cận dễ dàng nhất để chạy các mô hình LLM cục bộ trên thiết bị của bạn. Ứng dụng này cung cấp một ứng dụng máy tính để bàn (có sẵn trên macOS, Windows và Linux) cho phép bạn dễ dàng chạy các LLM trên thiết bị của mình.

Sau khi thiết lập, bạn có thể duyệt và tải các mô hình phổ biến như Llama, Mistral, Gemma, DeepSeek, Phi và Qwen trực tiếp từ Hugging Face chỉ với vài cú nhấp chuột. Sau khi tải, mọi thứ đều chạy ngoại tuyến, đảm bảo các lời nhắc và cuộc trò chuyện của bạn luôn riêng tư trên thiết bị.

Ứng dụng tự hào có giao diện người dùng trực quan, quen thuộc, vì vậy bạn sẽ cảm thấy hoàn toàn thoải mái nếu đã từng sử dụng các LLM dựa trên đám mây như Claude.

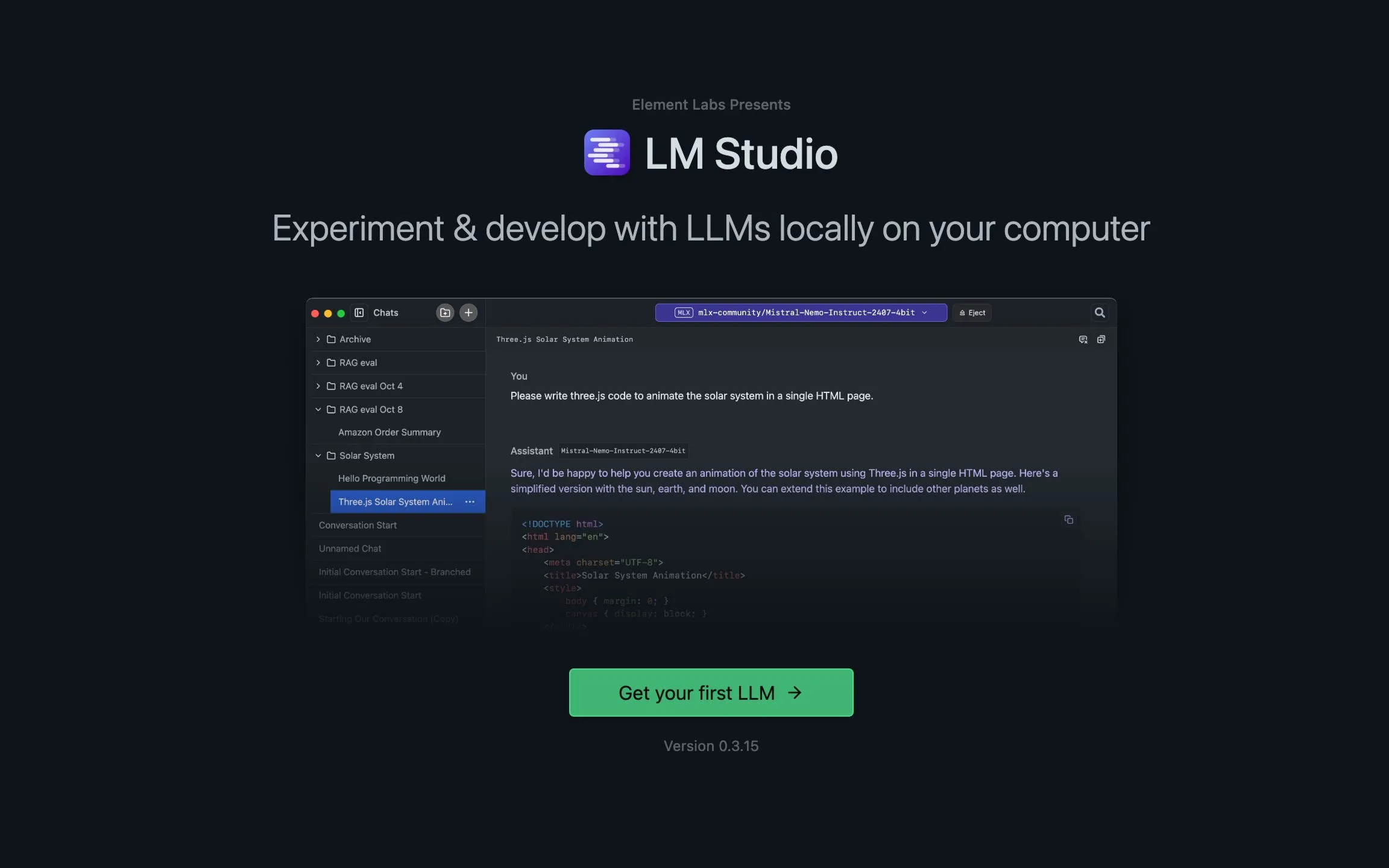

Màn hình khởi động của LM Studio, hướng dẫn người dùng bắt đầu chạy LLM cục bộ.

Màn hình khởi động của LM Studio, hướng dẫn người dùng bắt đầu chạy LLM cục bộ.

Có nhiều cách để chạy một LLM trên Linux, Windows, macOS hoặc bất kỳ hệ điều hành nào bạn sử dụng. Tuy nhiên, các ứng dụng được liệt kê ở đây cung cấp một số cách dễ dàng và tiện lợi nhất để làm điều đó. Một số có liên quan một chút đến giao diện dòng lệnh, trong khi những ứng dụng khác, như AnythingLLM và Jan.ai, cho phép bạn thực hiện mọi thứ từ giao diện người dùng đồ họa (GUI).

Tùy thuộc vào mức độ thoải mái về kỹ thuật của bạn, hãy thử một vài ứng dụng và gắn bó với ứng dụng phù hợp nhất với nhu cầu của bạn. Khám phá thế giới AI cục bộ ngay hôm nay để tận hưởng quyền riêng tư và sự linh hoạt tối đa!