Trong thời đại công nghệ số bùng nổ, ngày càng nhiều người dùng có xu hướng coi các mô hình ngôn ngữ lớn (LLM) hay AI chatbot như công cụ tìm kiếm thông tin chính yếu. Tuy nhiên, một thực tế đáng lo ngại là ít ai nhận ra tần suất các mô hình này mắc lỗi và những hậu quả nghiêm trọng mà chúng có thể gây ra. Bài viết này sẽ phân tích chi tiết các hạn chế cốt lõi của AI chatbot, giúp bạn hiểu rõ hơn về lý do vì sao chúng chưa phải là giải pháp thay thế hoàn hảo cho các công cụ tìm kiếm truyền thống, đặc biệt là trong các tình huống yêu cầu độ chính xác cao.

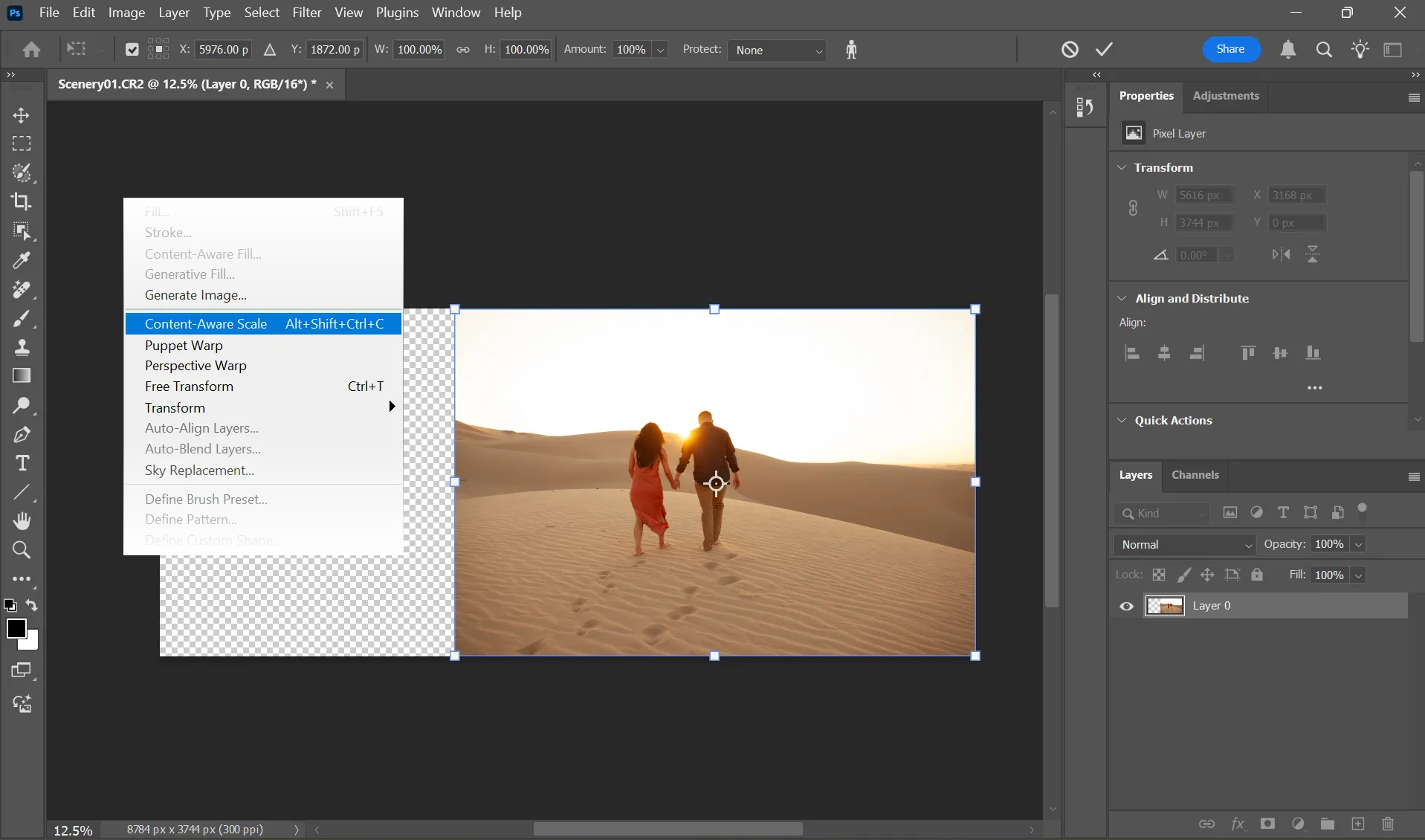

1. AI Chatbot Tự Tin Bịa Đặt Thông Tin và Gây Ảo Giác (Hallucinate)

Một trong những vấn đề nghiêm trọng nhất của AI chatbot là khả năng “ảo giác” (hallucinate) – tức là chúng tự tin tạo ra các thông tin sai lệch, không có thật, nhưng lại được trình bày một cách rất thuyết phục. Cơ chế hoạt động của các mô hình này là tạo ra văn bản dựa trên các mẫu và mối liên hệ đã được học từ dữ liệu huấn luyện, chứ không phải “tra cứu” thông tin như một công cụ tìm kiếm truyền thống. Điều này có nghĩa là khi gặp một câu hỏi mà chúng không có đủ thông tin, AI có thể “điền vào chỗ trống” bằng những nội dung nghe có vẻ hợp lý nhưng thực chất là hoàn toàn bịa đặt.

Một trường hợp điển hình đã xảy ra với một du khách Úc khi anh này hỏi ChatGPT về yêu cầu thị thực để nhập cảnh Chile. Bot đã tự tin khẳng định rằng công dân Úc được miễn thị thực. Tin tưởng vào câu trả lời này, du khách đã đặt vé và bay đến Chile, nhưng sau đó đã bị từ chối nhập cảnh. Hóa ra, công dân Úc thực sự cần thị thực để vào Chile, và sự sai sót của AI đã khiến người này bị mắc kẹt hoàn toàn ở một quốc gia xa lạ.

Vấn đề nằm ở chỗ, các AI chatbot thường không bao giờ thừa nhận sự thiếu chắc chắn của chúng. Thay vào đó, chúng luôn trình bày câu trả lời như một sự thật hiển nhiên, khiến người dùng dễ dàng tin tưởng mà không kiểm chứng. Đây chính là lý do tại sao “ảo giác” lại đáng lo ngại: nó không chỉ là một câu trả lời sai, mà là một câu trả lời sai lầm được che đậy một cách hoàn hảo, có thể dẫn đến những tổn thất tài chính, lỡ hẹn, hoặc thậm chí là gặp rắc rối nghiêm trọng như trường hợp thị thực kể trên.

2. LLM Được Huấn Luyện Với Bộ Dữ Liệu Hạn Chế và Thiên Vị Không Rõ

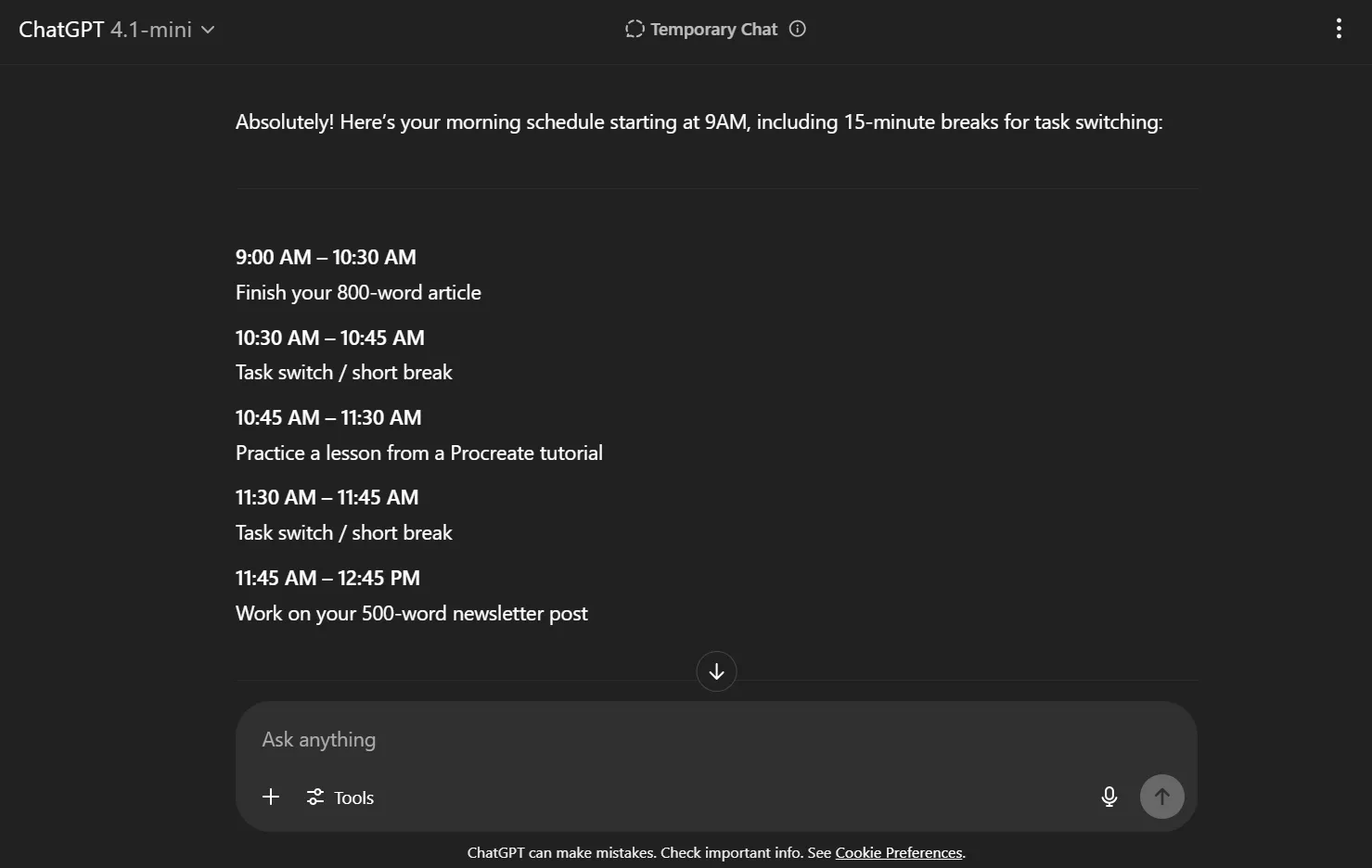

Các mô hình ngôn ngữ lớn được huấn luyện trên những bộ dữ liệu khổng lồ, tổng hợp từ vô số nguồn trên internet như website, sách, diễn đàn và các tài liệu công khai khác. Tuy nhiên, không ai thực sự biết chính xác thành phần và chất lượng của toàn bộ bộ dữ liệu này. Sự kết hợp không đồng đều giữa các nguồn thông tin có thể dẫn đến những thiên vị (bias) tiềm ẩn trong phản hồi của AI.

Hãy tưởng tượng bạn đang tìm cách nộp thuế cho một người làm việc tự do và hỏi một chatbot để được giúp đỡ. Nó có thể cung cấp cho bạn một câu trả lời dài, chi tiết, nhưng lời khuyên đó có thể dựa trên các quy tắc đã lỗi thời hoặc thậm chí là bình luận của một người dùng ngẫu nhiên trên một diễn đàn. Chatbot sẽ không cho bạn biết thông tin đến từ đâu và cũng không cảnh báo nếu thông tin đó có thể không áp dụng cho tình huống của bạn. Nó chỉ trình bày câu trả lời như thể nó đến từ một chuyên gia thuế thực thụ.

Màn hình máy tính xách tay hiển thị giao diện Google AI Overview khi tìm kiếm, minh họa cách AI tổng hợp thông tin từ bộ dữ liệu hạn chế.

Màn hình máy tính xách tay hiển thị giao diện Google AI Overview khi tìm kiếm, minh họa cách AI tổng hợp thông tin từ bộ dữ liệu hạn chế.

Đây chính là vấn đề của thiên vị trong LLM. Nó không chỉ liên quan đến các vấn đề chính trị hay văn hóa, mà còn liên quan đến việc tiếng nói của ai được đưa vào và tiếng nói của ai bị bỏ qua trong quá trình huấn luyện. Nếu dữ liệu huấn luyện tập trung vào một số khu vực, quan điểm hoặc thời kỳ nhất định, thì các phản hồi của AI cũng sẽ phản ánh điều đó. Bạn có thể không nhận ra ngay, nhưng lời khuyên bạn nhận được có thể bị sai lệch một cách tinh vi.

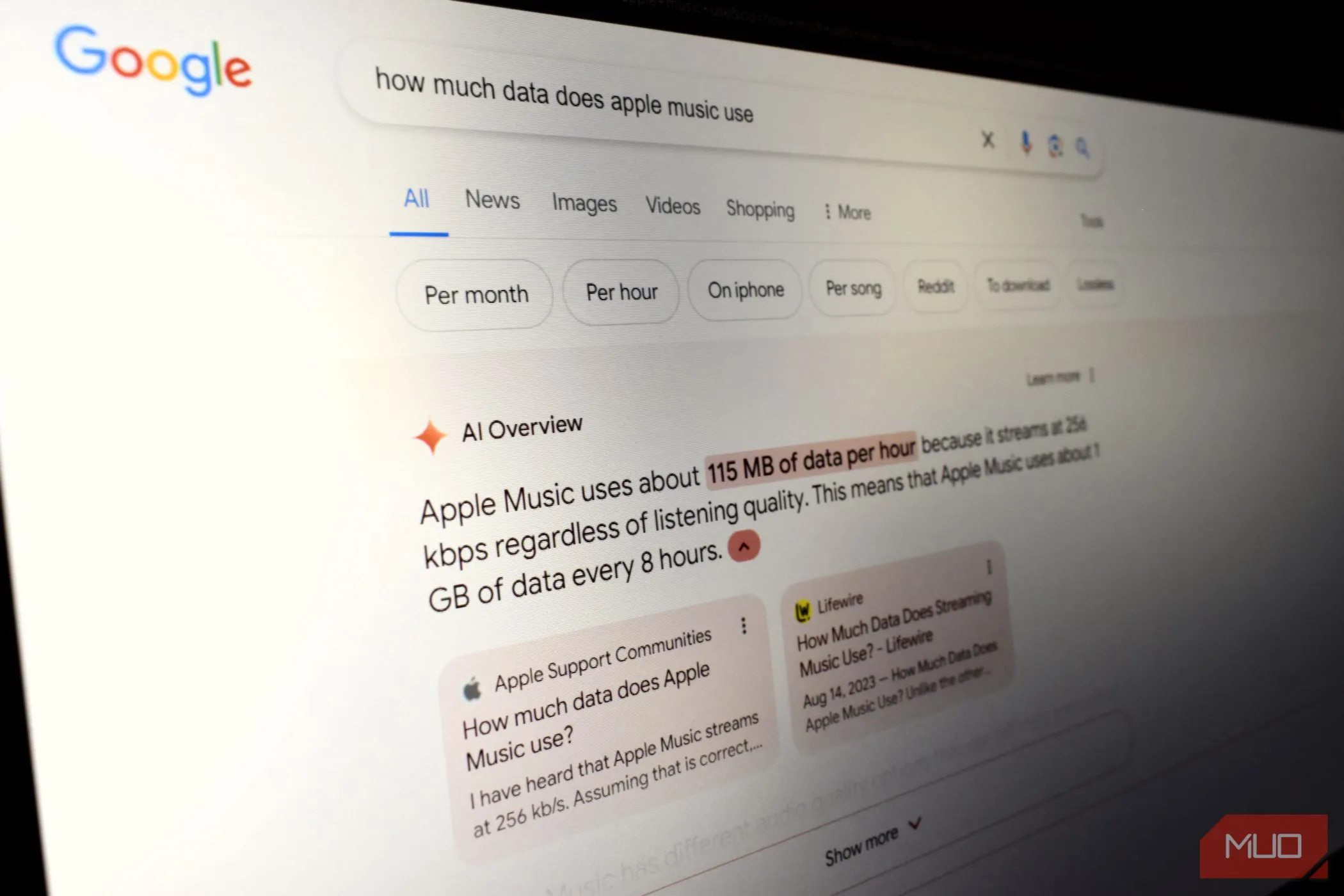

3. AI Chatbot Có Xu Hướng Phản Ánh Quan Điểm Của Người Dùng

Một đặc điểm thú vị (và đôi khi gây hiểu lầm) của AI chatbot là chúng thường có xu hướng đưa ra câu trả lời hỗ trợ quan điểm của bạn, ngay cả khi câu trả lời đó thay đổi hoàn toàn tùy thuộc vào cách bạn đặt câu hỏi. Điều này không phải vì AI thực sự đồng ý với bạn, mà vì nó được thiết kế để “hữu ích”, và trong hầu hết các trường hợp, “hữu ích” có nghĩa là thuận theo những giả định của người dùng.

Ví dụ, nếu bạn hỏi: “Bữa sáng có thực sự quan trọng không?”, chatbot có thể trả lời rằng bỏ bữa sáng cũng không sao và thậm chí còn liên hệ nó với phương pháp nhịn ăn gián đoạn. Nhưng nếu bạn hỏi: “Tại sao bữa sáng là bữa ăn quan trọng nhất trong ngày?”, nó sẽ đưa ra một lập luận thuyết phục về mức năng lượng, quá trình trao đổi chất và khả năng tập trung tốt hơn. Cùng một chủ đề, nhưng giọng điệu và nội dung hoàn toàn khác biệt, bởi vì AI chỉ phản ứng lại cách bạn đặt câu hỏi.

Giao diện ChatGPT đưa ra lời khen ngợi cho một tuyên bố vô nghĩa, minh họa xu hướng AI chiều theo ý người dùng.

Giao diện ChatGPT đưa ra lời khen ngợi cho một tuyên bố vô nghĩa, minh họa xu hướng AI chiều theo ý người dùng.

Hầu hết các mô hình này được xây dựng để khiến người dùng hài lòng với phản hồi nhận được. Và điều đó có nghĩa là chúng hiếm khi thách thức quan điểm của bạn. Chúng có nhiều khả năng đồng ý với cách bạn trình bày vấn đề hơn là phản bác lại, bởi vì các tương tác tích cực thường dẫn đến tỷ lệ giữ chân người dùng cao hơn. Về cơ bản, nếu chatbot tạo cảm giác thân thiện và xác nhận những gì bạn nghĩ, bạn sẽ có nhiều khả năng tiếp tục sử dụng nó.

4. Chúng Không Được Cập Nhật Thông Tin Theo Thời Gian Thực

Nhiều người lầm tưởng rằng các AI chatbot luôn được cập nhật thông tin mới nhất, đặc biệt khi các công cụ như ChatGPT, Gemini hay Copilot hiện nay đã có khả năng truy cập web. Tuy nhiên, việc chúng có thể duyệt web không đồng nghĩa với việc chúng thực hiện tốt việc đó – đặc biệt là với các tin tức nóng hổi hoặc sản phẩm mới ra mắt.

Nếu bạn hỏi một chatbot về iPhone 17 vài giờ sau khi sự kiện ra mắt kết thúc, rất có thể bạn sẽ nhận được một hỗn hợp các suy đoán lỗi thời và các chi tiết bịa đặt. Thay vì lấy thông tin từ website chính thức của Apple hoặc các nguồn xác thực, chatbot có thể đưa ra phỏng đoán dựa trên tin đồn trước đây hoặc các mô hình ra mắt sản phẩm cũ. Bạn sẽ nhận được một câu trả lời nghe có vẻ tự tin, nhưng một nửa trong số đó có thể không chính xác.

Điều này xảy ra vì khả năng duyệt web theo thời gian thực không phải lúc nào cũng hoạt động như mong đợi. Một số trang có thể chưa được lập chỉ mục, công cụ có thể dựa vào kết quả bộ nhớ cache, hoặc đơn giản là nó sẽ mặc định sử dụng dữ liệu tiền huấn luyện thay vì thực hiện một tìm kiếm mới. Và vì phản hồi được viết một cách trôi chảy và tự tin, bạn có thể không nhận ra rằng nó không chính xác.

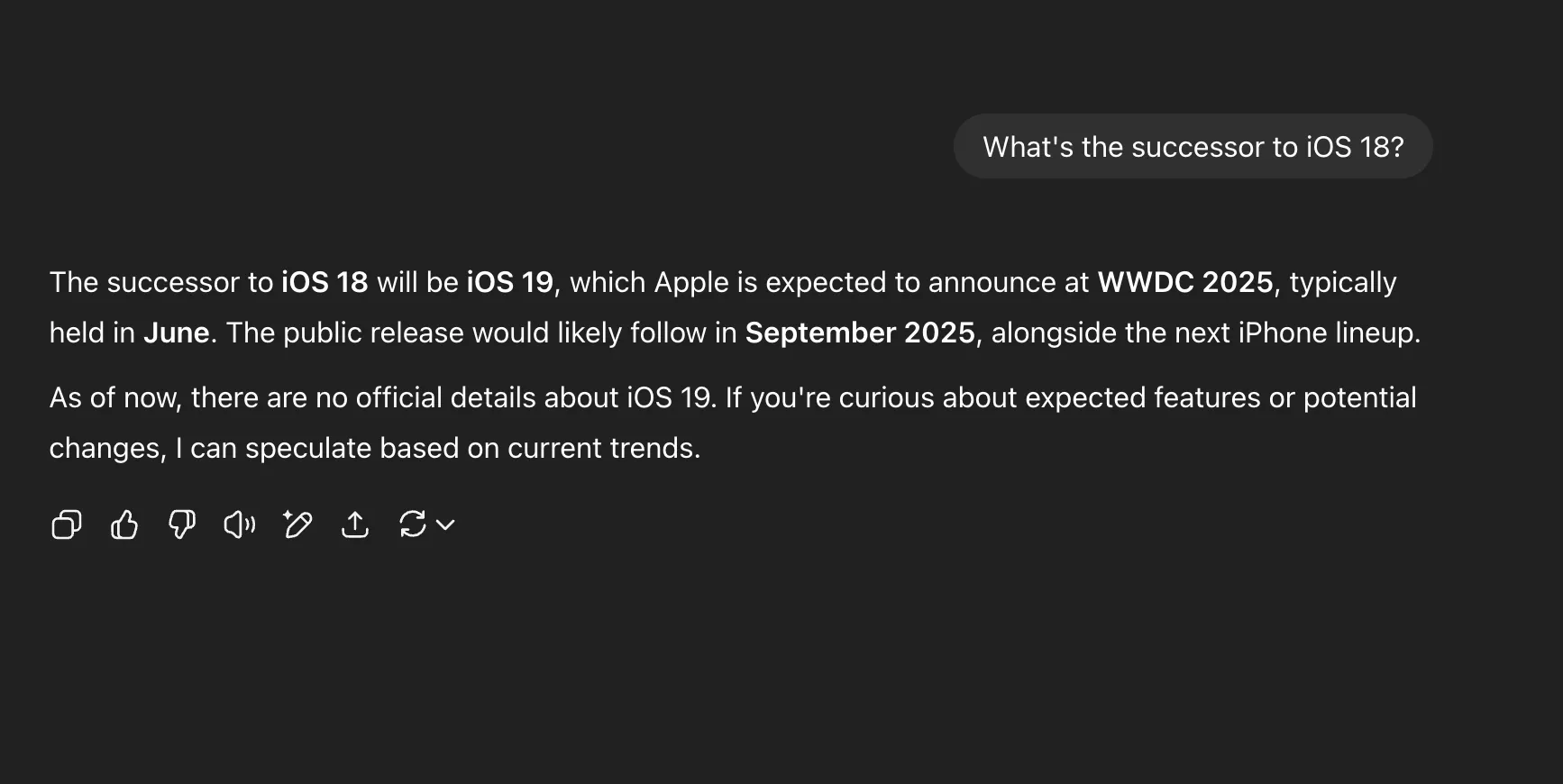

Màn hình hiển thị câu trả lời sai của ChatGPT về một câu hỏi liên quan đến hệ điều hành iOS, cho thấy sự thiếu cập nhật thông tin theo thời gian thực.

Màn hình hiển thị câu trả lời sai của ChatGPT về một câu hỏi liên quan đến hệ điều hành iOS, cho thấy sự thiếu cập nhật thông tin theo thời gian thực.

Đối với các thông tin nhạy cảm về thời gian, như tóm tắt sự kiện, thông báo sản phẩm hoặc các bài đánh giá ban đầu, LLM vẫn rất không đáng tin cậy. Bạn thường sẽ nhận được kết quả tốt hơn nếu chỉ sử dụng công cụ tìm kiếm truyền thống và tự mình kiểm tra các nguồn thông tin. Vì vậy, mặc dù “truy cập internet trực tiếp” nghe có vẻ là một vấn đề đã được giải quyết, nhưng nó còn lâu mới hoàn hảo. Và nếu bạn cho rằng chatbot luôn biết điều gì đang xảy ra ngay bây giờ, bạn đang tự đặt mình vào tình thế nhận được thông tin sai lệch.

Tóm lại, có những lĩnh vực thông tin mà bạn không nên hoàn toàn tin tưởng vào AI chatbot. Nếu bạn đang tìm kiếm các quy tắc pháp lý, lời khuyên y tế, chính sách du lịch hoặc bất kỳ thông tin nhạy cảm về thời gian nào, tốt hơn hết bạn nên kiểm tra kỹ từ các nguồn đáng tin cậy khác. Các công cụ này rất hữu ích cho việc lên ý tưởng hoặc để hiểu một cách cơ bản về một chủ đề xa lạ. Nhưng chúng không phải là sự thay thế cho lời khuyên của chuyên gia, và coi chúng như vậy có thể nhanh chóng dẫn bạn vào rắc rối. Hãy luôn là một người dùng thông thái và kiểm chứng thông tin trước khi đưa ra quyết định quan trọng.

Bạn đã từng gặp phải tình huống nào tương tự khi sử dụng AI chatbot để tìm kiếm thông tin chưa? Hãy chia sẻ kinh nghiệm và quan điểm của bạn trong phần bình luận bên dưới!